Die Europäische KI-Verordnung – auch EU AI Act genannt – markiert das weltweit erste umfassende Regelwerk für den Einsatz von Künstlicher Intelligenz. Seit dem 1. August 2024 gilt sie unmittelbar in Deutschland und allen EU-Staaten und führt ein risikobasiertes System ein: KI-Anwendungen werden je nach Gefahrenpotenzial unterschiedlich streng reguliert. Startups und KMU sind von den Vorgaben nicht ausgenommen, doch die Gesetzgeber haben explizit auf praxisnahe Erleichterungen für kleine Unternehmen geachtet.

Warum sollten Sie als Startup-Gründer die KI-Verordnung ernst nehmen? Ganz einfach: Wer jetzt die Weichen richtig stellt, macht aus der vermeintlichen Regulierungslast einen echten Wettbewerbsvorteil. Der AI Act verfolgt dabei drei Kernziele – Grundrechtsschutz, Transparenz und innovationsfreundliche Rahmenbedingungen – und bietet gerade Startups spezielle Unterstützung durch vereinfachte Verfahren und Beratungsangebote.

Im Folgenden zeigen wir Ihnen, wie Sie die KI-Verordnung für Startups ohne Bürokratie-Marathon meistern können. Dabei stützen wir uns auf aktuelle Fakten, praxiserprobte Experteneinschätzungen und die offiziellen EU-Leitlinien – alles, was Sie wirklich wissen müssen, kompakt aufbereitet.

Key Takeaways KI-Verordnung Startups

- EU AI Act gilt ab 2024 und ist risikobasiert: Die KI-Verordnung reguliert KI-Systeme je nach Risiko. Hochriskante KI (z.B. in Medizin oder Personalwesen) unterliegt strengen Auflagen, während triviale KI-Anwendungen kaum Pflichten haben.

- Pflichten für Unternehmen: Entwickler und Nutzer von KI müssen je nach Rolle Risikobewertungen durchführen, für Transparenz sorgen und technische Dokumentation erstellen. Insbesondere bei Hochrisiko-KI sind Qualitäts- & Risikomanagement, Konformitätsprüfungen und genaue Protokollierung vorgeschrieben.

- Strenge Sanktionen mit Mäßigung für Startups: Bei Verstößen drohen Bußgelder bis zu 35 Mio. € oder 7 % des Jahresumsatzes. Für Startups und KMU gelten jedoch jeweils die niedrigeren Schwellen, um Existenzgefährdung zu vermeiden.

- Keine Ausnahmen, aber Entlastungen für KMU: Der AI Act sieht keine generellen Ausnahmen für Startups vor, berücksichtigt aber ihre Bedürfnisse. Vereinfachte Dokumentationspflichten, kostenlose Beratungsstellen und KI-"Reallabore" (regulatorische Sandboxes) sollen bürokratischen Aufwand minimieren.

- Übergangsfristen bis 2026: Obwohl die Verordnung am 1. August 2024 in Kraft getreten ist, gelten viele Kernpflichten erst nach Übergangsfristen. Verbotene KI-Praktiken (z.B. Social Scoring) sind schon ab 2. Februar 2025 untersagt; die vollen Anforderungen für Hochrisiko-Systeme greifen ab 2. August 2026.

- Chance statt Last: Experten betonen, dass der AI Act für Startups strategische Chancen bietet. Wer Compliance by Design früh integriert, kann sich als vertrauenswürdiger Anbieter profilieren. Mit klaren Leitlinien und europäischen Standards lässt sich ein Wettbewerbsvorteil erzielen, statt Innovationsfähigkeit zu verlieren.

Was ist die EU KI-Verordnung? Hintergrund & Ziele

Die EU KI-Verordnung (AI Act) ist ein am 12. Juli 2024 im EU-Amtsblatt veröffentlichtes Gesetzespaket, das einen einheitlichen Rechtsrahmen für KI Entwicklung, Vertrieb und Nutzung von KI innerhalb der EU schafft. Als Verordnung gilt sie seit Inkrafttreten am 1. August 2024 unmittelbar in allen Mitgliedstaaten – ohne nationale Umsetzungsgesetze. Ihre Hauptziele sind laut offiziellem Text: Schutz von Grundrechten und Sicherheit, Förderung vertrauenswürdiger KI sowie Vermeidung eines regulatorischen Flickenteppichs durch EU-weit harmonisierte Regeln.

Die Verordnung wurde von der Europäische Kommission bereits 2021 vorgeschlagen und nach intensiven Verhandlungen im Mai 2024 vom EU-Parlament verabschiedet. Sie gilt als Reaktion auf Risiken der KI: Diskriminierung, Intransparenz, Sicherheitslücken – aber auch auf globale Konkurrenz. So entfallen in H1 2024 nur 6 % der weltweiten KI-Startup-Investitionen auf die Europäische Union (ca. 35 Mrd. USD weltweit). Durch klare Regeln will Europa Vertrauen schaffen und gleichzeitig seine Wettbewerbsfähigkeit gegenüber USA und China stärken.

Wichtige Definitionen: Die KI-VO definiert zentral, was unter KI-Systemen fällt. Laut Art. 3 KI-VO ist dies „ein maschinengestütztes System, das für einen in unterschiedlichem Grade autonomen Betrieb ausgelegt ist und das nach seiner Betriebsaufnahme anpassungsfähig sein kann und das aus den erhaltenen Eingaben für explizite oder implizite Ziele ableitet, wie Ausgaben wie etwa Vorhersagen, Inhalte, Empfehlungen oder Entscheidungen erstellt werden". Erfasst sind somit alle Arten von Software mit KI-Methoden (Machine Learning, Expertensysteme etc.), egal ob kommerziell oder Open Source (sofern in Verkehr gebracht). Kurzum: Die KI-Verordnung betrifft branchenübergreifend nahezu alle KI-Anwendungen, von Chatbots bis zu Algorithmen in Medizin und Fintech.

Risikoklassen der KI-VO: Von minimal bis Hochrisiko

Ein zentrales Prinzip der KI-Verordnung ist der risikobasierte Ansatz. KI-Systeme werden in vier Kategorien eingestuft, die jeweils unterschiedliche rechtliche Folgen haben:

Unannehmbares Risiko – Verbotene KI-Praktiken

Anwendungen, die fundamentale Grundrechte verletzen oder erhebliche Gefahren bergen, sind EU-weit verboten. Laut AI Act zählen dazu z.B. Social Scoring-Systeme (Bewertung von Personen über Verhalten/Eigenschaften), unzulässige biometrische Überwachung im öffentlichen Raum, automatisierte Erkennung von Emotionen am Arbeitsplatz sowie KI, die Menschen manipulativ beeinflusst oder Schwächen ausnutzt. Diese Praktiken sind bereits 6 Monate nach Verabschiedung – also seit 02. Februar 2025 – untersagt. Verstöße können sofort eingeklagt oder behördlich gestoppt werden.

Hohes Risiko – Streng regulierte KI-Systeme

Diese bilden den Schwerpunkt der Regulierung. Darunter fallen KI-Systeme, die in sensiblen Bereichen eingesetzt werden, etwa kritische Infrastrukturen, medizinische Geräte, Personalrekrutierung, Bildungs- und Prüfungswesen, Finanz- und Kreditwürdigkeit, Strafverfolgung, Migration/Asylentscheidungen oder Justiz. Solche Hochrisiko-KI-Systeme sind nicht verboten, unterliegen aber umfangreichen Auflagen (siehe nächster Abschnitt).

Beispiel: Eine KI, die Bewerbungen vorsortiert oder Kreditanträge bewertet, gilt als hochriskant und muss bestimmte Kriterien erfüllen.

[Infografik: Vier Risikostufen der KI-Verordnung mit Beispielen]

Begrenztes Risiko – Transparenzpflichtige KI

KI-Systeme, die weder hochriskant noch minimal sind, fallen in eine mittlere Kategorie. Typische Beispiele: Chatbots, Deepfakes oder Recommendation-Algorithmen. Solche Systeme dürfen frei genutzt werden, müssen aber Transparenzanforderungen erfüllen. Konkret verlangt die KI-VO hier, dass Nutzer informiert werden, wenn sie mit einer KI interagieren (z.B. Hinweis „Dieses Gespräch wird von einer KI geführt") oder wenn Inhalte KI-generiert sind (Kennzeichnung von AI-generierten Bildern/Videos als solche). Dies schafft Vertrauen und hilft, Manipulation zu vermeiden.

Minimales Risiko – Frei nutzbare KI

Für alle übrigen KI-Anwendungen, die weder in obige Kategorien fallen (z.B. Spam-Filter, Routenplaner oder automatisierte Übersetzungen), gelten keine besonderen Pflichten. Die EU ermutigt jedoch freiwillige Verhaltenskodizes auch für diese einfachen Anwendungen.

Pflichten und Anforderungen: Was müssen Startups für KI-Compliance tun?

Je nach Rolle (Anbieter, Inverkehrbringer, Nutzer) und Risikoklasse des KI-Systems auferlegt die Verordnung verschiedene Compliance-Pflichten. Die wichtigsten Anforderungen, die Startups mit KI-Bezug unbedingt kennen sollten:

Risikomanagement & Bewertung

Anbieter von Hochrisiko-KI müssen ein Risikomanagementsystem implementieren. Vor Markteinführung ist eine Risikoanalyse durchzuführen, inkl. Abschätzung von Auswirkungen auf Grundrechte. Grundsatz: Keine KI ohne vorherige Prüfung der Risiken. Für bestehende KI-Systeme in Unternehmen empfiehlt sich analog eine Bestandsaufnahme mit Risiko-Priorisierung.

Technische Dokumentation & Konformitätserklärung

Für jede KI-Anwendung mit mehr als minimalem Risiko ist eine Dokumentation erforderlich. Insbesondere Hochrisiko-KI verlangt eine umfassende technische Dokumentation gemäß Anhang IV KI-VO, inkl. Beschreibung des Modells, Datensätze, Leistungsbewertungen etc. Startups als Anbieter solcher Systeme müssen zudem vor Inverkehrbringen eine Konformitätsbewertung durchführen und eine EU-Konformitätserklärung ausstellen. Positiv: Die EU-Kommission entwickelt vereinfachte Dokumentations-Vorlagen für KMU, um den Aufwand zu reduzieren.

Datenqualität & -Governance

Eingesetzte Datensätze müssen repräsentativ, vollständig und frei von Verzerrungen sein (Art. 10 KI-VO). Es gelten strenge Anforderungen an Datenqualität und Dokumentation der Datenherkunft – insbesondere für Trainingsdaten hochriskanter KI. Bei generativer KI (GPAI) kommen zusätzliche Pflichten hinzu, etwa Zusammenfassungen der Trainingsdaten und Gewährleistung der Urheberrechtskonformität beim Training.

[Infobox: Die 6 wichtigsten Compliance-Pflichten für Startups]

Transparenz & Kennzeichnung

Unternehmen müssen Nutzer klar informieren, wann sie es mit KI zu tun haben. Art. 52 KI-VO fordert, dass KI-Systeme, die mit Menschen interagieren (z.B. Chatbots), als KI-System gekennzeichnet werden. Gleiches gilt für KI-generierte Inhalte: sogenannte Deepfakes oder synthetische Medien müssen als solche kenntlich gemacht werden, sofern kein rechtmäßiger Zweck (etwa Satire) dagegensteht.

Menschliche Aufsicht

Hochrisiko-Systeme dürfen nicht völlig autonom entscheiden, wo es um grundlegende Rechte geht (z.B. Ablehnung eines Kredits). Anbieter müssen Maßnahmen zur menschlichen Überwachung und Eingriffsmöglichkeiten vorsehen (Art. 14 KI-VO). Mitarbeiter, die KI bedienen, sind entsprechend zu schulen („KI-Kompetenz" nach Art. 4).

Melde- und Nachberichtspflichten

Treten bei einem Hochrisiko-KI-System schwerwiegende Vorfälle oder Fehlfunktionen auf, muss dies innerhalb von 15 Tagen an die Aufsichtsbehörde gemeldet werden (Art. 62). Außerdem müssen Betreiber solcher Systeme deren Performance und Compliance laufend überwachen und der EU-Datenbank melden.

Zusatzpflichten für General-Purpose AI (GPAI)

Allgemeine KI-Modelle (wie große Sprachmodelle) unterliegen ab August 2025 ebenfalls Pflichten. Anbieter müssen z.B. Nutzungsanleitungen für Entwickler bereitstellen und ggf. Herkunftsnachweise für generierte Inhalte einbauen. Große Foundation-Modelle mit „systemischem Risiko" (z.B. sehr große Modelle à la ChatGPT, Kriterien in Anhang XIII) erfordern überdies ein Risikomanagement ähnlich Hochrisiko-KI und Registrierung beim neuen EU-KI-Register.

Zwischenfazit: Startups sollten früh Prozesse etablieren, um diese Anforderungen zu erfüllen. Wir raten Compliance-Anforderungen von Anfang an in den Entwicklungsprozess einzubetten, um Kosten zu minimieren und Vorgaben effizient umzusetzen. Dieses "Compliance by Design"-Prinzip erlaubt es, Innovation und Regeltreue zu vereinen, statt sie als Widerspruch zu sehen.

Erleichterungen für Startups und KMU: KI-Compliance ohne Überforderung

Trotz des umfassenden Pflichten-Katalogs hat die EU die Belange von Startups und kleinen Unternehmen explizit berücksichtigt. In den Erwägungsgründen 8, 109 und 143 des AI Act verpflichten sich EU-Kommission und Mitgliedstaaten, unverhältnismäßige Belastungen für KMU zu vermeiden. Konkrete Erleichterungen und Unterstützungsangebote sind:

Vereinfachte Dokumentation

Die EU-Kommission soll ein vereinfachtes Formular für die technische Dokumentation von Hochrisiko-KI-Systemen erstellen, speziell zugeschnitten auf KMU und Start-ups. Damit wird der bürokratische Aufwand reduziert, ohne die inhaltlichen Anforderungen abzusenken.

Praxisbeispiel: Ein kleines Startup, das eine KI-Software im Gesundheitsbereich entwickelt, könnte statt hunderter Seiten Doku ein komprimiertes Template nutzen, das die Mindestanforderungen abdeckt (gemäß Art. 11 Abs. 1 KI-VO).

KI-Reallabore (Regulatory Sandboxes)

Der AI Act führt regulatorische Sandboxes ein, genannt KI-Reallabore, in denen Unternehmen neue KI-Lösungen unter aufsichtsrechtlicher Begleitung und realen Bedingungen testen können. KMU und Startups erhalten priorisierten, kostengünstigen Zugang – teils sogar gebührenfrei – und profitieren von vereinfachten Antragsverfahren. So können Innovationen erprobt werden, ohne von Tag 1 alle Pflichten zu 100 % erfüllen zu müssen. Deutschland plant, ein solches KI-Reallabor bei der Bundesnetzagentur einzurichten.

Kostenlose Beratung & Anlaufstellen

Die Mitgliedstaaten müssen nationale Kontaktstellen für KMU benennen (Art. 55 KI-VO). Diese Stellen sollen kostenlose oder niedrigschwellige Beratung anbieten, damit gerade Startups sich über die neuen Vorgaben informieren und Hilfe bei der Umsetzung erhalten. Zudem fungieren sie als zielgruppengerechte Informationskanäle, die Fragen kleinerer Akteure bündeln und verständlich beantworten.

Mildere Sanktionen für KMU

Wie bereits erwähnt, sieht Art. 71 KI-Gesetz vor, dass bei der Bemessung von Geldbußen die wirtschaftlichen Überlebenschancen von KMU berücksichtigt werden. Für Startups bedeutet das konkret: Im Falle eines Verstoßes soll nicht der höhere der beiden Strafwerte (Prozentsatz vs. Fixbetrag) angewandt werden, sondern stets der niedrigere. Praktisch würde ein kleines Startup also im schlimmsten Fall eher z.B. 7% vom Umsatz zahlen statt 35 Mio. €, wenn 7% weniger als 35 Mio. € sind.

Expertenstimme: "Startups brauchen Tempo, Klarheit und einheitliche Regeln. Eine zentral organisierte KI-Aufsicht kann Bürokratie abbauen – so wird die KI-Verordnung weniger zur Last, sondern zum Wettbewerbsvorteil." – Verena Pausder, Vorsitzende Startup-Verband (Berlin).

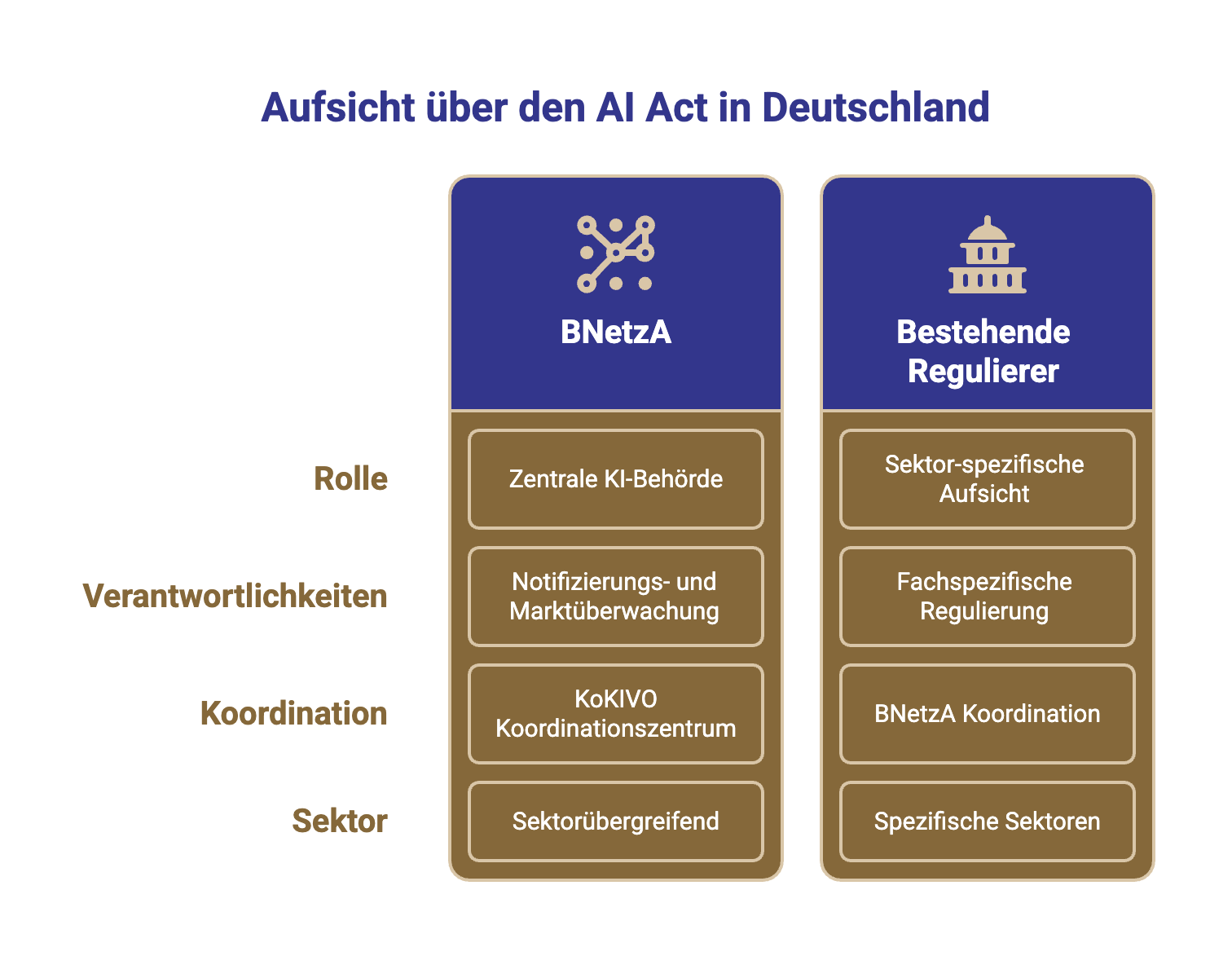

Aufsicht & Durchsetzung in Deutschland: Welche Behörde überwacht die KI-VO?

Die Überwachung der KI-Verordnung erfolgt arbeitsteilig durch EU-Institutionen und nationale Behörden. Für Startups ist wichtig zu wissen, an wen sie sich halten bzw. wenden müssen:

Bundesnetzagentur (BNetzA) als zentrale KI-Behörde

Deutschland hat entschieden, die Bundesnetzagentur zur Leitbehörde für den AI Act zu machen. Ein Referentenentwurf (Stand Sept. 2025) sieht vor, dass die BNetzA sowohl notifizierende Behörde (zuständig für Konformitätsbewertungen) als auch Marktüberwachungsbehörde wird. Als Koordinierungs- und Kompetenzzentrum "KoKIVO" soll sie bundeseinheitliche Auslegung sicherstellen und andere Fachbehörden beraten. Damit folgt man der Forderung der Startup-Branche nach einer starken, zentralen Aufsicht statt föderalem Wirrwarr.

Branchenaufsicht durch bestehende Stellen

Um Doppelstrukturen zu vermeiden, sollen vorhandene Regulierer eingebunden werden. Beispielsweise könnten für KI in Medizinprodukten weiterhin die Medizintechnikbehörden zuständig sein, für KI im Finanzsektor die Bafin, jedoch unter Koordinierung der BNetzA. Dieses "hybride Modell" ist im deutschen KI-Marktüberwachungs- und Innovationsförderungsgesetz (KI-MIG) vorgesehen.

Aufgaben der Aufsicht

Die BNetzA bzw. zuständige Behörde wird KI-Systeme prüfen und zulassen (insb. Hochrisiko-KI vor Markteintritt), Audits und Inspektionen durchführen und bei Verstößen Maßnahmen ergreifen. Sanktionen reichen von Bußgeldern bis zum Verbot des KI-Systems. Zudem dient die Behörde – wie oben erwähnt – als Beratungsstelle, gerade für KMU.

Rechtsdurchsetzung und Klagemöglichkeiten

Verstöße gegen die KI-VO können nicht nur von Amts wegen verfolgt werden, sondern theoretisch auch gerichtlich von Betroffenen untersagt werden. Bürgerinnen und Bürger haben das Recht, Beschwerde einzulegen, wenn KI-Systeme ihre Rechte beeinträchtigen. Unternehmen sollten daher bereits aus Reputationsgründen größtmögliche Sorgfalt walten lassen, um keine "KI-Skandale" zu riskieren.

Sanktionen bei Verstößen: Bußgelder, Haftung und Folgen

Strenge Strafen: Ähnlich der DSGVO setzt die KI-Verordnung auf empfindliche Bußgelder, um die Einhaltung durchzusetzen. Für schwerwiegende Verstöße – etwa Einsatz verbotener KI oder Missachtung von Datenvorschriften - drohen bis zu 35 Mio. € oder 7 % des weltweiten Vorjahresumsatzes als Geldbuße (je nachdem, welcher Wert höher ist). Zum Vergleich: DSGVO-Maximum sind 20 Mio. € oder 4 % Umsatz – der AI Act setzt hier also noch eins drauf.

Abgestufte Bußgeldhöhen: Bei weniger gravierenden Verstößen sinken die Obergrenzen. Beispielsweise sind für Verletzungen sonstiger Pflichten (z.B. Kennzeichnung, Konformitätsverfahren) bis zu 15 Mio. € oder 3 % Umsatz angesetzt. Fehlende Kooperation oder falsche Angaben gegenüber Behörden können bis 7,5 Mio. € oder 1,5 % Umsatz geahndet werden. Diese mehrstufige Struktur ermöglicht der Behörde, die Sanktion proportional zum Verstoß zu wählen.

[Tabelle: Bußgeldstaffelung nach Verstoß-Schwere]

Milderung für Startups: Wie bereits erwähnt, gelten für KMU und Start-ups stets die niedrigeren Beträge der oben genannten Spannen. Diese Klausel (Art. 71 Abs. 5 AI Act) soll verhindern, dass junge Firmen durch Strafen in die Insolvenz getrieben werden. Zudem kann die Behörde bei geringfügigen Verstößen Verwarnungen aussprechen, insbesondere bei erstmaligen Vergehen ohne Schaden – in der Praxis ein weiterer wichtiger Puffer für Startups.

Haftung & Zivilklagen: Unabhängig von Bußgeldern müssen Unternehmen beachten, dass geschädigte Personen Schadenersatz verlangen könnten. Die EU plant ergänzend einen AI Liability Act, der Beweislastregeln zugunsten von Opfern vorsieht (z.B. bei Diskriminierung durch KI). Schon nach geltendem Recht können fehlerhafte KI-Produkte Produkthaftung auslösen. Für Startups heißt das: Eine solide Haftpflichtversicherung für KI-Risiken und gründliche Tests vor Deployment sind dringend angeraten.

Fazit: Fahrplan für Startups – KI-Compliance als Chance begreifen

Die KI-Verordnung der EU bringt tiefgreifende Veränderungen für alle, die KI-Systeme entwickeln oder einsetzen – gerade auch Startups. Doch anstatt das befürchtete "Bürokratie-Monster" zu sein, liefert der AI Act einen klaren Rahmen, in dem Innovation stattfinden kann.

Startups sollten die Übergangszeit bis 2025/2026 nutzen, um frühzeitig Compliance-Strukturen aufzubauen: etwa interne Verantwortliche benennen (KI-"Officer"), Dokumentationsprozesse definieren und bestehende KI-Anwendungen auf Risiken prüfen. Mit Unterstützung durch Sandboxes und Beratungsstellen können diese Aufgaben bewältigt werden, ohne das Tagesgeschäft lahmzulegen.

Wichtig ist, die Vorteile der Regelung aktiv zu nutzen: Transparente und vertrauenswürdige KI wird am Markt besser angenommen – ein Startup, das nachweislich ethische und sichere KI anbietet, kann hieraus Kapital schlagen. Zudem schafft die EU-Regulierung Rechtssicherheit und gleichen Wettbewerb für alle in Europa. Das vermeidet Wildwuchs nationaler Regeln und erleichtert die Expansion in andere EU-Länder.

Insgesamt gilt: KI-Compliance muss kein Chaos sein. Mit Planung, den richtigen Ressourcen und einer positiven Einstellung als Enabler statt Verhinderer lässt sich der AI Act erfolgreich umsetzen. So können Startups nicht nur Risiken minimieren, sondern Vertrauen und Wettbewerbsvorteile gewinnen – getreu dem Motto: "Compliance by Design" for Future Success.

Jetzt KI-Compliance sichern: Kostenlose Erstberatung zur KI-Verordnung

Als spezialisierte Rechtsberatung für Technologie- und Datenschutzrecht unterstützt ODC Legal Startups und mittelständische Unternehmen bei der rechtssicheren Implementierung von KI-Lösungen. Profitieren Sie von unserer Expertise im Bereich KI-Compliance und verwandeln Sie regulatorische Anforderungen in Wettbewerbsvorteile.

FAQ – Häufige Fragen zur KI-Verordnung (AI Act)

Was ist die KI-Verordnung der EU?

Die KI-Verordnung (EU AI Act) ist ein EU-weit geltendes Gesetz, das Entwicklung, Einsatz und Vertrieb von KI-Systemen reguliert. Es verfolgt einen risikobasierten Ansatz: Je nach Gefahrenpotenzial gelten unterschiedliche Auflagen. Ziel der Verordnung ist es, vertrauenswürdige KI zu fördern und gleichzeitig Grundrechte, Sicherheit und Verbraucher zu schützen.

Wann tritt das EU-AI Act in Kraft?

Die EU-KI-Verordnung ist am 1. August 2024 formell in Kraft getreten. Allerdings gelten viele Bestimmungen erst nach Übergangsfristen: Verbotene KI-Praktiken sind seit 02.02.2025 untersagt, die meisten Pflichten (insb. für Hochrisiko-KI) greifen ab 02.08.2026 EU-weit. Bis dahin haben Unternehmen Zeit, sich auf die neuen Regeln vorzubereiten.

Wer wird durch die KI-Verordnung in die Pflicht genommen?

Die KI-VO gilt für alle Anbieter, Händler und Nutzer von KI-Systemen in der EU – unabhängig von Größe oder Branche. Selbst nicht-europäische Unternehmen fallen darunter, wenn sie KI-Systeme in der EU auf den Markt bringen oder deren Outputs in der EU genutzt werden. Auch öffentliche Stellen und Privatpersonen können erfasst sein, sofern sie KI in Verkehr bringen. Kurz: Jeder, der KI-Lösungen entwickelt, einsetzt oder verkauft, muss die Vorgaben beachten (Stand: 2025).

Gibt es Ausnahmen oder Erleichterungen für Startups bei der KI-Verordnung?

Ausnahmen im Sinne von Freistellungen gibt es nicht – die KI-VO gilt auch für Startups und KMU vollumfänglich. Allerdings sind Erleichterungen vorgesehen: Die EU will unverhältnismäßigen Aufwand vermeiden. So soll es etwa vereinfachte Dokumentationsvorlagen für KMU geben, kostenlose Beratungsangebote der Behörden und bei Sanktionen werden die Interessen von Startups berücksichtigt (kleinere Bußgelder). Kurzum: Startups müssen die Regeln einhalten, profitieren aber von Unterstützung und milderen Konsequenzen (Stand: 2025).

Vereinbaren Sie jetzt Ihr Erstgespräch

Erfahren Sie, wie wir Ihnen helfen können und erhalten Sie wertvolle rechtliche Beratung.

.jpg)

.webp)