Wenn Ihr Unternehmen künstliche Intelligenz einsetzt oder den Einsatz von KI Systemen plant, stehen Sie vor einer doppelten Herausforderung: Sie müssen sowohl die Datenschutz-Grundverordnung (DSGVO) als auch die neue EU-KI-Verordnung (AI Act) einhalten. Die Schnittstelle zwischen diesen beiden Regelwerken wird für Unternehmen im Jahr 2025 zur Nagelprobe – denn hier entscheidet sich, ob KI-Datenschutz Compliance gelingt oder ob empfindliche Sanktionen drohen. ki rich

Die Zahlen sprechen eine klare Sprache: DSGVO-Verstöße können mit Bußgeldern bis zu 20 Millionen Euro oder 4 Prozent des weltweiten Jahresumsatzes geahndet werden. Die KI-Verordnung geht noch weiter und sieht Strafen von gestaffelten Bußgeldern vor, die in der Spitze bis zu 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes erreichen können. Für technologieorientierte Unternehmen, die auf KI-Systeme setzen, wird damit die KI-Compliance zum geschäftskritischen Faktor.

In diesem umfassenden Leitfaden zeigen wir Ihnen, welche präventiven Compliance-Maßnahmen Ihr Unternehmen ergreifen sollte und wie effektives Risikomanagement beim Einsatz von KI aussieht. Sie erfahren, wie Sie die Anforderungen beider Regelwerke unter einen Hut bekommen und dabei die Chancen künstlicher Intelligenz für Ihr Geschäft nutzen können.

Key Takeaways: Das Wichtigste zu KI Compliance auf einen Blick

- Die DSGVO und der EU AI Act bilden gemeinsam den regulatorischen Rahmen für den Einsatz von künstlicher Intelligenz mit personenbezogenen Daten

- Hochrisiko-KI-Systemen unterliegen besonders strengen Anforderungen bei Transparenz, Dokumentation und menschlicher Aufsicht

- Präventive Maßnahmen wie Datenschutz-Folgenabschätzungen und interne Governance-Strukturen sind unverzichtbar

- Ein systematisches Risikomanagement hilft, im Ernstfall Schäden zu begrenzen und Compliance-Verstößen vorzubeugen

- KI Compliance ist kein Kostenfaktor, sondern ein strategischer Wettbewerbsvorteil im digitalen Markt

Regulatorische Grundlagen: DSGVO und KI-Verordnung im Zusammenspiel

Die DSGVO: Fundament des Datenschutzes bei KI-Nutzung

Die Datenschutz-Grundverordnung ist seit 2018 in Kraft und legt strenge Regeln zum Schutz personenbezogener Daten fest. Für Unternehmen bedeutet dies konkret: Sie müssen technische und organisatorische Maßnahmen (TOM) umsetzen, den Grundsätzen wie Transparenz, Zweckbindnung und Datenminimierung folgen und gegebenenfalls einen Datenschutzbeauftragten bestellen.

Die Aufsichtsbehörden verstehen bei Verstößen keinen Spaß. Es drohen Geldbußen von bis zu 20 Millionen Euro oder 4 Prozent des globalen Vorjahresumsatzes – je nachdem, welcher Betrag höher ist. Darüber hinaus können geschädigte Personen Schadenersatzansprüche geltend machen, falls eine unrechtmäßige Datenverarbeitung ihnen einen materiellen oder immateriellen Schaden zufüg

Für KI-Systeme ist die DSGVO besonders relevant, da diese typischerweise große Mengen an Daten verarbeiten – oft auch personenbezogene. Beim Einsatz von KI müssen Unternehmen sicherstellen, dass die Datenverarbeitung rechtmäßig erfolgt, die Betroffenenrechte gewahrt bleiben und die Daten angemessen geschützt sind.

Die EU-KI-Verordnung: Weltweit erstes umfassendes KI-Regelwerk

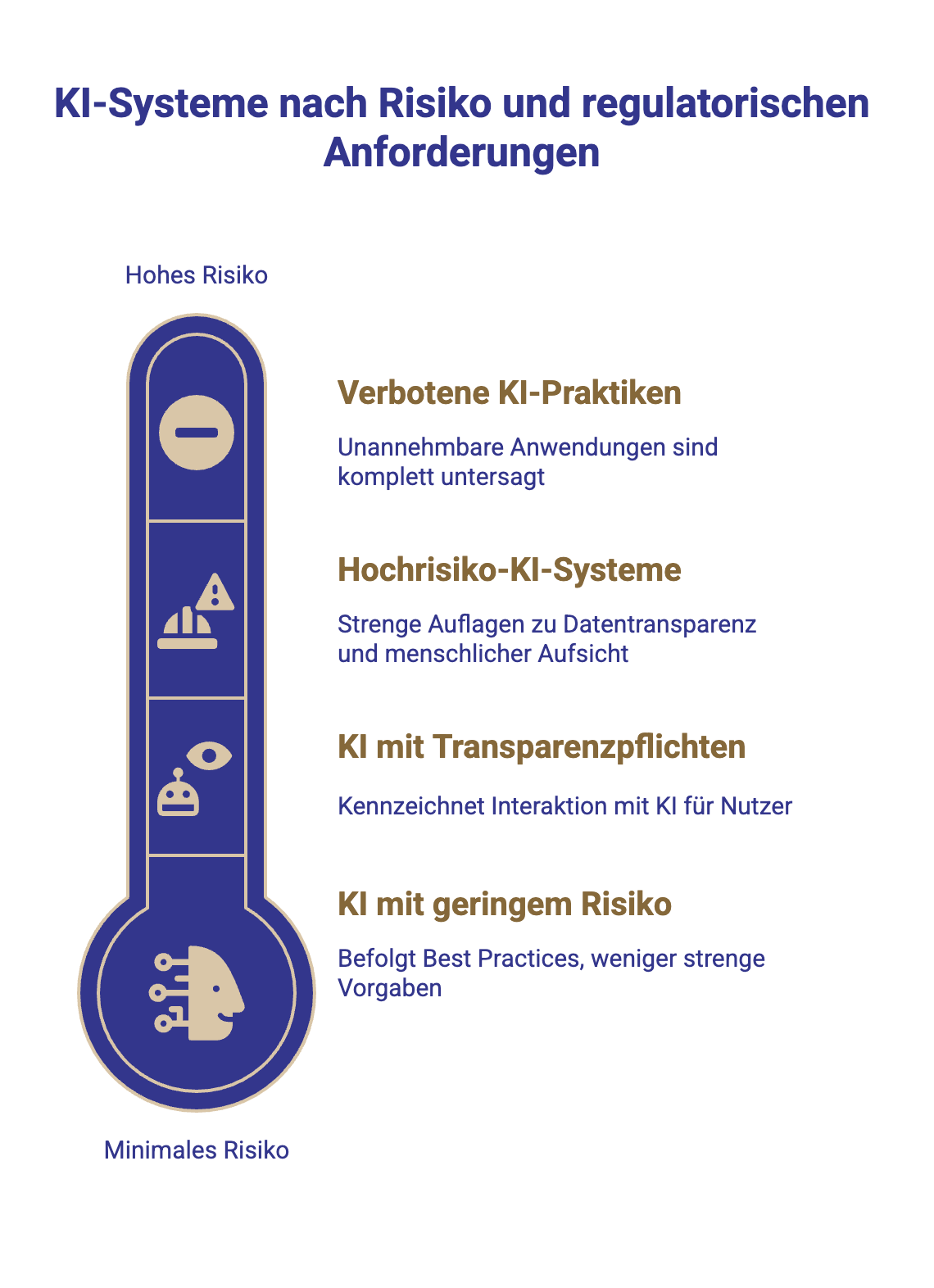

Der EU AI Act ist die weltweit erste umfassende Regulierung für künstliche Intelligenz in der EU, trat im August 2024 in Kraft und seine Regeln werden stufenweise anwendbar, beginnend mit den ersten Verboten im Februar 2025. Die KI-VO verfolgt einen risikobasierten Ansatz: KI-Systeme werden je nach Risiko in Kategorien eingeteilt – von minimalem Risiko bis zu Hochrisiko-KI-Systemen in sensiblen Bereichen wie Personalwesen, Medizin oder kritischer Infrastruktur.

Die Risikokategorien im Überblick:

- Verbotene KI-Praktiken: Bestimmte unannehmbare KI-Anwendungen sind komplett untersagt, etwa Social Scoring durch staatliche Stellen oder manipulative Techniken, die Menschen schädigen könnten.

- Hochrisiko-KI-Systeme: Für diese gelten strenge Auflagen in Bezug auf Datentransparenz, Dokumentation, menschliche Aufsicht und Qualität der Daten. Die Anforderungen ähneln in ihrem präventiven Charakter den Datenschutzregeln der DSGVO. So sind beispielsweise Bias-freie Trainingsdaten, technische Dokumentation und kontinuierliche Risikoanalysen Pflicht.

- KI mit Transparenzpflichten: Systeme wie Chatbots oder KI-generierte Inhalte müssen als solche gekennzeichnet werden, damit Nutzer wissen, dass sie mit einer KI interagieren.

- Minimalrisiko-KI: Für KI mit geringem Risiko gelten weniger strenge Vorgaben, allerdings sollten auch hier Best Practices befolgt werden.

Sanktionen und Strafen: Was bei Nichteinhaltung droht

Bei Nichteinhaltung der KI-Verordnung drohen empfindliche Strafen, gestaffelt nach Schwere des Verstoßes. Die Bußgelder können bis zu 30 Millionen Euro beziehungsweise 6 Prozent vom Umsatz erreichen – in schweren Fällen bei verbotenen KI-Praktiken sogar 35 Millionen Euro oder 7 Prozent. Diese enormen Bußgelder sollen Unternehmen motivieren, die Anforderungen ernst zu nehmen und ihre KI-Systeme bereits jetzt auf Compliance zu trimmen.

Die kumulative Wirkung: Mehr als die Summe ihrer Teile

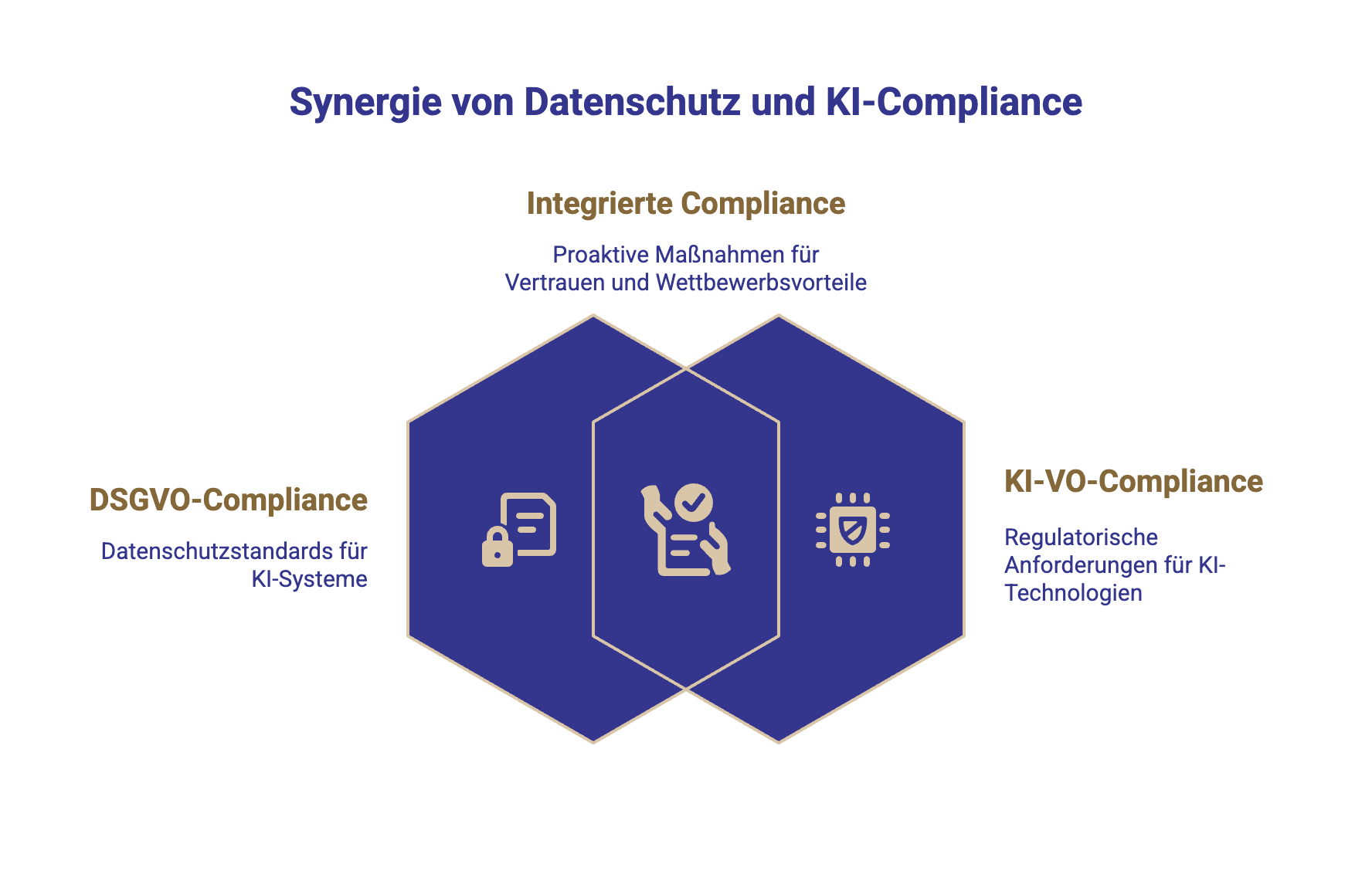

Beide Regelwerke – DSGVO und AI Act – verlangen von Unternehmen proaktive Maßnahmen. Die gesetzliche Neuerungen, inklusive der KI-VO und verwandter Gesetze wie dem Data Act oder NIS-2, erhöhen kumulativ die präventiven Anforderungen an die IT-Sicherheit und Compliance in Unternehmen.

Die gute Nachricht: Wer Datenschutz und KI-Regulierung effektiv umsetzt, minimiert nicht nur Risiken, sondern stärkt auch das Vertrauen von Kunden und Partnern. KI Compliance wird damit zum Qualitätsmerkmal und Wettbewerbsvorteil.

Präventive Compliance-Maßnahmen: Vorbeugen statt heilen

Angesichts der hohen rechtlichen Anforderungen sollte der Fokus auf vorbeugender Compliance liegen – also darauf, Verstöße gar nicht erst entstehen zu lassen. Die Nutzung von KI erfordert einen strukturierten Ansatz, der sowohl technische als auch organisatorische Aspekte berücksichtigt.

Datenschutz-Folgenabschätzung: Der erste Schritt zu compliance-konformen KI-Projekten

Führen Sie bei neuen KI-Projekten oder Technologien, die personenbezogene Daten verarbeiten, eine Datenschutz-Folgenabschätzung (DPIA) durch. DPIAs nach DSGVO sind Pflicht, wenn eine Verarbeitung voraussichtlich ein hohes Risiko für die Rechte von Personen mit sich bringt – etwa bei automatisierter Entscheidungsfindung oder umfangreichem Profiling.

Dieser Prozess hilft, potenzielle Datenschutzrisiken frühzeitig zu erkennen und präventive Maßnahmen zu ergreifen, noch bevor ein KI-Projekt startet. Durch eine sorgfältige Risikoanalyse und Dokumentation gemäß Artikel 35 DSGVO können Schwachstellen beseitigt werden, bevor Schaden entsteht.

Best Practices für DPIAs bei KI-Systemen:

- Beschreiben Sie detailliert, welche Daten das KI-System verarbeitet und zu welchem Zweck

- Bewerten Sie die Notwendigkeit und Verhältnismäßigkeit der Datenverarbeitung

- Identifizieren Sie Risiken für Betroffenenrechte, insbesondere bei automatisierten Entscheidungen

- Definieren Sie konkrete Maßnahmen zur Risikominimierung

- Dokumentieren Sie den gesamten Prozess nachvollziehbar

Interne Governance: Verantwortlichkeiten und Prozesse klar regeln

Etablieren Sie interne Richtlinien und Verantwortlichkeiten für Datenschutz und KI. Ein Compliance-Management-System (CMS) stellt sicher, dass Datenschutzprinzipien und KI-Vorgaben in allen Abteilungen verankert sind. Klare Richtlinien zur Datenverarbeitung, Löschkonzepte, Zugriffsbeschränkungen und ein Berechtigungsmanagement sind essenziell.

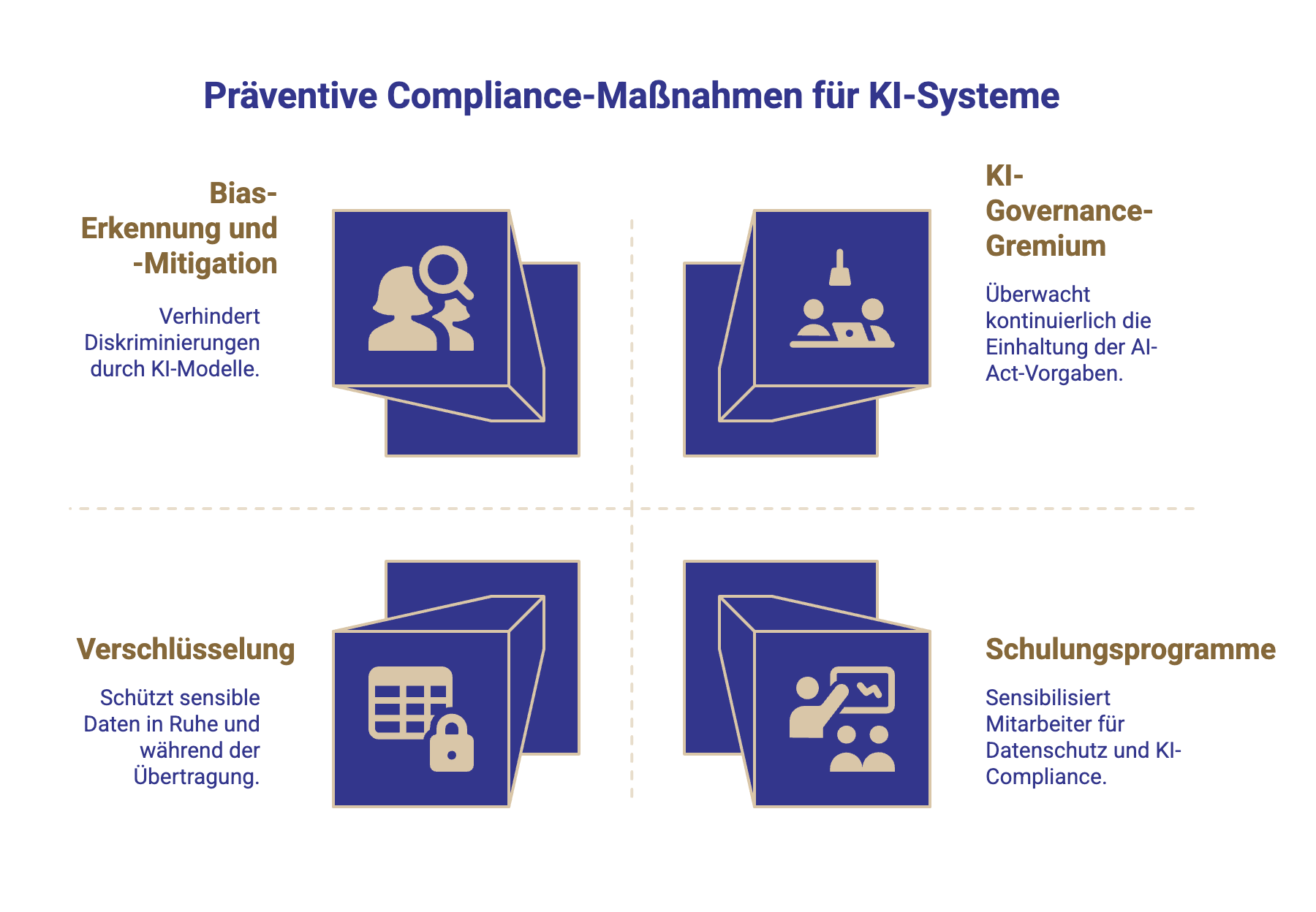

Für die KI Compliance sollten Unternehmen zudem ein KI-Governance-Gremium oder zumindest feste Zuständigkeiten benennen. Diese Governance-Strukturen überwachen kontinuierlich die Einhaltung der AI-Act-Vorgaben, etwa bei Risikoanalysen und Algorithmus-Prüfungen.

Elemente einer effektiven KI-Governance:

- Benennung eines KI-Verantwortlichen oder KI-Compliance-Officers

- Klare Entscheidungswege für die Einführung neuer KI-Systeme

- Regelmäßige Audits und Reviews von KI-Anwendungen

- Schulungsprogramme für alle relevanten Mitarbeiter

- Dokumentation aller KI-Entscheidungen und -Prozesse

Technische und organisatorische Maßnahmen: Die Basis der Datensicherheit

Sowohl DSGVO als auch AI Act verlangen den Einsatz geeigneter technischer und organisatorischer Schutzmaßnahmen. Dazu zählen Datenverschlüsselung, Pseudonymisierung, Zugriffskontrollen und regelmäßige Sicherheitsüberprüfungen der IT-Infrastruktur.

Insbesondere Anbieter von Hochrisiko-KI-Systemen müssen dafür sorgen, dass ihre Systeme robust, sicher und frei von unvertretbaren Verzerrungen (Bias) sind. Die Qualitätskontrolle der Trainingsdaten ist entscheidend, um Diskriminierungen durch KI vorzubeugen.

Technische Schutzmaßnahmen beim KI-Einsatz:

- Verschlüsselung sensibler Daten in Ruhe und während der Übertragung

- Implementierung von Access-Control-Mechanismen mit Least-Privilege-Prinzip

- Logging und Monitoring aller KI-Entscheidungen

- Regelmäßige Penetrationstests und Sicherheitsaudits

- Bias-Erkennung und -Mitigation in KI-Modellen

- Versionskontrolle und Änderungsmanagement für KI-Systeme

Außerdem fordert der AI Act eine ausführliche technische Dokumentation und Log-Aufzeichnung, damit die Konformität eines KI-Systems von Behörden nachvollzogen werden kann. Diese Dokumentation entspricht gewissermaßen dem Verzeichnis von Verarbeitungstätigkeiten unter der DSGVO und sollte stets aktuell gehalten werden.

Transparenz und Information: Vertrauen durch Offenheit schaffen

Stellen Sie sicher, dass Betroffene und Nutzer verstehen, wie ihre Daten verarbeitet werden und wo KI zum Einsatz kommt. Nach DSGVO müssen Datenschutzhinweise klar und verständlich sein; Betroffene haben umfassende Rechte auf Auskunft, Berichtigung und Löschung gemäß Artikel 15 bis 17 DSGVO.

Der AI Act bringt zusätzliche Transparenzpflichten für KI-Systeme: Anwender hochriskanter KI müssen umfassend über Zweck, Funktionsweise und Limits des Systems informiert werden. Wenn KI-generierte Inhalte eingesetzt werden – seien es Texte, Bilder oder Videos – besteht eine Kennzeichnungspflicht, damit für Dritte erkennbar ist, dass der Inhalt von einer KI stammt.

Diese Transparenz schafft Vertrauen und ermöglicht es Nutzern, informierte Entscheidungen zu treffen. Im Marketing und bei der Kundenkommunikation ist dies besonders relevant: Kunden schätzen es, wenn Unternehmen offen mit dem Thema KI umgehen.

Schulung und Sensibilisierung: Der Mensch im Fokus

Mitarbeiter-Schulungen sind ein oft unterschätzter Compliance-Faktor. Alle Mitarbeiter sollten die Grundlagen des Datenschutzes kennen und wissen, wie sie im Arbeitsalltag datenschutzkonform handeln – von der Phishing-Erkennung über sichere Passwörter bis zum korrekten Umgang mit Betroffenenanfragen.

Darüber hinaus verlangt der AI Act, dass Unternehmen ihre Beschäftigten im Umgang mit KI-Systemen schulen. Wenn Ihr Unternehmen KI-Tools nutzt, etwa für Personalentscheidungen oder Kundenanalysen, müssen die verantwortlichen Personen ausreichend Kompetenzen im Verständnis und in der Kontrolle dieser KI vorweisen.

Schulungsthemen für KI Compliance:

- Grundlagen der DSGVO und des AI Act

- Erkennung und Vermeidung von algorithmischen Verzerrungen

- Interpretierbarkeit von KI-Entscheidungen

- Korrekte Reaktion bei Fehlfunktionen oder unerwarteten Ergebnissen

- Eskalationsprozesse bei Compliance-Problemen

- Ethische Aspekte der KI-Nutzung

Eine informierte Belegschaft hilft, menschliche Fehler oder Fehlbedienungen zu vermeiden, die sonst Compliance-Verstöße auslösen könnten. Regelmäßige Schulungen – mindestens jährlich – sollten zur Routine werden.

Risikomanagement bei Datenschutz- und KI-Verstößen

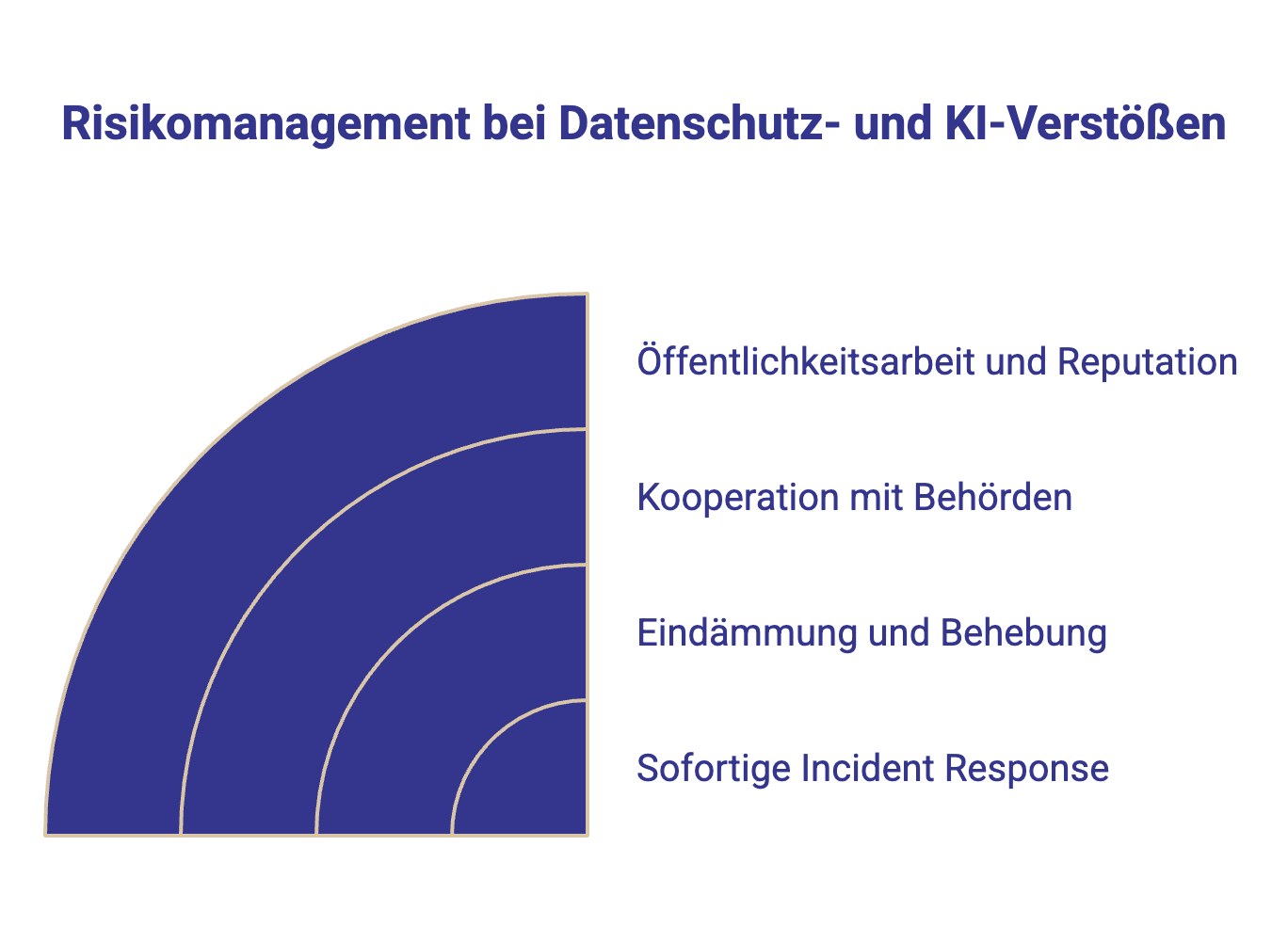

Trotz aller Prävention kann kein Unternehmen absolute Sicherheit garantieren. Daher ist ein professionelles Risikomanagement nötig, um im Falle eines Datenschutzvorfalls oder eines KI-Compliance-Verstoßes Schäden zu begrenzen. Klare Prozesse und Verantwortlichkeiten ermöglichen es, schnell und effektiv zu reagieren.

Sofortige Incident Response: Zeit ist der kritische Faktor

Sobald ein Verstoß oder eine Datenpanne entdeckt wird, muss Ihr internes Notfallteam aktiviert werden. Klären Sie zunächst, was passiert ist, welche Daten oder Personen betroffen sind und welches Ausmaß der Vorfall hat. Diese Einschätzung des Risikos bildet die Grundlage für alle weiteren Schritte.

Gemäß DSGVO sind Meldungen an die Aufsichtsbehörden innerhalb von 72 Stunden vorgeschrieben, sofern mehr als ein geringes Risiko für Betroffene besteht. Versäumen Unternehmen diese Frist, drohen zusätzliche Sanktionen.

Ab einer bestimmten Schwere des Vorfalls – wenn hohe Risiken für die Rechte der Betroffenen vorliegen – müssen auch die betroffenen Personen unverzüglich informiert werden. Ein strukturierter Notfallplan mit vorbereiteten Meldungen und Kommunikationsvorlagen stellt sicher, dass in der Hektik nichts vergessen wird.

Checkliste für die erste Reaktion:

- Vorfall sofort dokumentieren (Zeitpunkt, Art, Umfang)

- Betroffene Systeme isolieren oder herunterfahren

- Forensische Analyse einleiten

- Datenschutzbeauftragten und Geschäftsführung informieren

- Risikobewertung durchführen (geringes vs. hohes Risiko)

- Meldung an Aufsichtsbehörde vorbereiten (wenn erforderlich)

- Kommunikationsplan aktivieren

Eindämmung und Behebung: Den Schaden begrenzen

Parallel zur Meldung sollten sofort Maßnahmen ergriffen werden, um den Schaden zu begrenzen. Bei einer Datenschutzverletzung bedeutet dies: Lecks schließen, unbefugten Zugriff beenden, kompromittierte Passwörter zurücksetzen, betroffene Systeme patchen.

Bei einem KI-Compliance-Verstoß – etwa wenn ein KI-System aufgrund eines Fehlers diskriminierende Ergebnisse liefert oder gegen Vorschriften verstößt – könnte dies bedeuten, das System vorübergehend abzuschalten oder zurückzusetzen, fehlerhafte Algorithmen zu korrigieren oder Datensätze zu bereinigen.

Wichtig ist, dass alle Schritte dokumentiert werden. So können Sie gegenüber Behörden nachweisen, dass Sie Ihrer Eindämmungs- und Mitwirkungspflicht nachkommen. Der AI Act fordert bei Hochrisiko-KI, dass schwerwiegende Vorfälle gemäß Artikel 73 KI-VO an die Behörden gemeldet und untersucht werden. Die Meldung muss in der Regel spätestens 15 Tage nach Kenntnisnahme erfolgen.

Kooperation mit Behörden: Transparenz zahlt sich aus

Die Zusammenarbeit mit den zuständigen Datenschutz- und KI-Aufsichtsbehörden ist im Ernstfall essenziell. Zeigen Sie sich einsichtig und kooperativ. Stellen Sie den Behörden alle erforderlichen Informationen zur Verfügung – die technische Dokumentation Ihres KI-Systems, das Verarbeitungsverzeichnis nach DSGVO, die DPIA-Dokumentation.

Eine offene Kommunikation kann sich positiv auf das Verfahren auswirken. Zudem sollten Sie frühzeitig Ihre juristischen Berater einschalten. Datenschutzverstöße und KI-Regularien sind komplex – ein erfahrener Rechtsbeistand hilft, die richtigen Entscheidungen zu treffen, Fristen einzuhalten und die Kommunikation juristisch einwandfrei zu gestalten.

Beachten Sie, dass neben behördlichen Bußgeldern auch Betroffene zivilrechtlich klagen könnten. Eine rechtliche Bewertung, ob und welche Schadensbegrenzung oder Vergleiche möglich sind, gehört deshalb ebenfalls zum Krisenmanagement.

Öffentlichkeitsarbeit und Reputation: Vertrauen zurückgewinnen

Ein oft unterschätzter Aspekt des Risikomanagements ist die Öffentlichkeitsarbeit. Wenn ein gravierender Vorfall publik wird – etwa ein Datenleck mit Kundeninformationen – steht der Ruf Ihres Unternehmens auf dem Spiel.

Bereiten Sie Kommunikationsstrategien vor: Wer informiert Presse und Kunden? Welche Kernbotschaften sollen vermittelt werden? Ziel muss es sein, verloren gegangenes Vertrauen durch Transparenz und konkrete Wiedergutmachungsmaßnahmen zurückzugewinnen.

Viele Unternehmen veröffentlichen bei größeren Datenschutzpannen proaktiv Erklärungen und bieten eventuell betroffenen Kunden Unterstützung an. Eine ehrliche, schnelle Kommunikation kann Imageschäden begrenzen – zumal in Zeiten von sozialen Medien Gerüchte sonst die Oberhand gewinnen.

Compliance als strategischer Vorteil: Der Wettbewerbsvorteil vertrauenswürdiger KI

KI Compliance ist mehr als Risikominimierung – sie ist ein strategischer Wettbewerbsvorteil. Unternehmen, die Datenschutz und ethische KI als Qualitätsmerkmal etablieren, positionieren sich als vertrauenswürdige Partner im digitalen Markt.

Vertrauen als Währung

In einer Zeit, in der Künstliche Intelligenz und Datenschutz zunehmend im Fokus der öffentlichen Diskussion stehen, wird Vertrauen zur entscheidenden Währung. Kunden und Geschäftspartner bevorzugen Unternehmen, die transparent mit KI umgehen und Datenschutz ernst nehmen.

Proaktive Konformität stärkt die Reputation als zukunftsorientierter, verantwortungsvoller Marktteilnehmer. Dies kann konkrete Geschäftsvorteile bringen: bessere Kundenbindung, Zugang zu neuen Märkten, Vorsprung bei öffentlichen Ausschreibungen.

Innovation und Compliance: Kein Widerspruch

Manche befürchten, strenge Regulierung hemme Innovation. Die Erfahrung zeigt jedoch: Klare Regeln schaffen Planungssicherheit und fördern verantwortungsvolle Innovation. Unternehmen, die von Beginn an Compliance mitdenken, vermeiden teure Nachbesserungen und Rechtsstreitigkeiten.

Der risikobasierte Ansatz des AI Act ermöglicht es, KI-Systeme mit geringem Risiko flexibel zu entwickeln, während hochriskante Anwendungen strengeren Kontrollen unterliegen. Dies ist ein ausgewogener Ansatz, der Innovation ermöglicht und gleichzeitig Schutz gewährleistet.

Best Practices als Wettbewerbsvorteil

Unternehmen, die heute in robuste Compliance-Strukturen investieren, positionieren sich als Vorreiter. Sie können ihre Erfahrung nutzen, um Kunden zu beraten, eigene KI-Produkte zu zertifizieren oder als Branchenführer wahrgenommen zu werden.

Einige konkrete Chancen: Zertifizierungen und Gütesiegel für vertrauenswürdige KI als Marketinginstrument

- Consulting-Angebote für andere Unternehmen auf dem Weg zur KI Compliance

- Vorsprung bei der Entwicklung compliant-by-design KI-Lösungen

- Attraktivität als Arbeitgeber für qualifizierte Fachkräfte, die ethische KI schätzen

Ihr Partner für rechtssichere KI-Nutzung

Die Anforderungen an KI Compliance sind komplex und entwickeln sich ständig weiter. Bei ODC Legal verfügen wir über umfassende Erfahrung im Datenschutzrecht und der KI-Regulierung. Wir unterstützen Unternehmen dabei, die rechtlichen Herausforderungen zu meistern und gleichzeitig die Chancen künstlicher Intelligenz zu nutzen.

Unsere Leistungen umfassen:

- Rechtliche Bewertung Ihrer KI-Systeme und Compliance-Status

- Durchführung von Datenschutz-Folgenabschätzungen für KI-Projekte

- Entwicklung maßgeschneiderter KI-Governance-Strukturen

- Schulung Ihrer Mitarbeiter zu DSGVO und AI Act

- Unterstützung bei Behördenkommunikation und Incident Response

- Vertragsgestaltung für KI-Anbieter und -Nutzer

Kontaktieren Sie uns für eine unverbindliche Erstberatung. Gemeinsam entwickeln wir eine Strategie, die Ihr Unternehmen rechtssicher aufstellt und gleichzeitig Innovationskraft erhält. Bei ODC Legal verbinden wir juristische Expertise mit technischem Verständnis – für Lösungen, die in der Praxis funktionieren.

Jetzt Erstgespräch vereinbaren

FAQ: Häufige Fragen zu KI-Datenschutz Compliance

Wann ist eine Datenschutz-Folgenabschätzung bei KI-Systemen erforderlich?

Eine DPIA ist Pflicht, wenn die Verarbeitung voraussichtlich ein hohes Risiko für die Rechte und Freiheiten natürlicher Personen mit sich bringt. Dies ist bei automatisierten Entscheidungen mit rechtlicher Wirkung, umfangreichem Profiling oder der Verarbeitung sensibler Daten der Fall. Bei den meisten KI-Anwendungen, die personenbezogene Daten verarbeiten, sollte eine DPIA durchgeführt werden.

Was sind die Hauptunterschiede zwischen DSGVO und KI-Verordnung?

Die DSGVO regelt den Schutz personenbezogener Daten generell, während der AI Act speziell künstliche Intelligenz reguliert – auch wenn keine personenbezogenen Daten verarbeitet werden. Der AI Act nutzt einen risikobasierten Ansatz mit gestaffelten Anforderungen je nach KI-Risikoklasse, während die DSGVO auf alle Datenverarbeitungen anwendbar ist, die personenbezogene Daten betreffen.

Welche KI-Systeme gelten als Hochrisiko-KI?

Hochrisiko-KI-Systeme sind solche, die in besonders sensiblen Bereichen eingesetzt werden: biometrische Identifikation, kritische Infrastruktur, Bildung, Beschäftigung, wesentliche private und öffentliche Dienste, Strafverfolgung, Migration und Grenzverwaltung sowie Rechtspflege. Diese Kategorien unterliegen den strengsten Anforderungen des AI Act.

Können KI-Tools wie ChatGPT DSGVO-konform eingesetzt werden?

Ja, aber nur unter bestimmten Voraussetzungen. Sie müssen sicherstellen, dass keine sensiblen personenbezogenen Daten in KI-Assistenten eingegeben werden, einen Auftragsverarbeitungsvertrag mit dem Anbieter abschließen, eine DPIA durchführen und Mitarbeiter im datenschutzkonformen Umgang schulen. Die Nutzungsbedingungen und Datenschutzerklärung des Anbieters sollten sorgfältig geprüft werden.

Brauche ich einen Datenschutzbeauftragten für KI-Projekte?

Die Pflicht zur Bestellung eines Datenschutzbeauftragten hängt nicht direkt vom KI-Einsatz ab, sondern von den allgemeinen DSGVO-Kriterien: in der Regel bei öffentlichen Stellen, bei umfangreicher systematischer Überwachung oder bei umfangreicher Verarbeitung besonderer Kategorien personenbezogener Daten. Bei vielen KI-Projekten mit Personenbezug ist jedoch die Einbindung eines Datenschutzbeauftragten oder -experten dringend zu empfehlen.

Vereinbaren Sie jetzt Ihr Erstgespräch

Erfahren Sie, wie wir Ihnen helfen können und erhalten Sie wertvolle rechtliche Beratung.

.jpg)

.webp)